Contenidos

Porque importa: En un esfuerzo por lograr un equilibrio entre fomentar la innovación en inteligencia artificial y asegurar que las empresas no abusen de ella para diversos fines, la Comisión Europea propondrá próximamente una serie de regulaciones que sin duda aumentarán las tensiones con Estados Unidos a la vez. la región se está quedando atrás del resto del mundo en la carrera de la IA.

El año pasado, la Comisión Europea reveló sus planes para un “proyecto generacional” que debería reducir la dependencia de la región de empresas externas para productos y servicios digitales. Varias propuestas siguen siendo objeto de debate público, pero la mayoría de ellas giran en torno a la creación de una nueva política de mercado digital que tendrá implicaciones de gran alcance para gigantes tecnológicos como Google, Amazon, Facebook, Microsoft y todas las demás empresas que recaudan una gran cantidad de datos para proporcionar a AI.

El anuncio oficial de las reglas propuestas se espera la próxima semana, pero gracias a un documento filtrado obtenido por Politico, ahora tenemos una visión preliminar sobre cuáles son esas reglas. Según el borrador de 81 páginas, la Comisión Europea está tratando de prohibir completamente los sistemas de IA de “alto riesgo” si no cumplen con ciertos criterios. Por ejemplo, el documento especifica que “debe prohibirse la vigilancia indiscriminada de personas físicas cuando se aplique de manera generalizada a todas las personas sin diferenciación”.

Las empresas que no cumplan con los criterios podrían ser multadas con el 4% de su facturación anual o hasta 20 millones de euros (23,95 millones de dólares).

La Comisión también quiere prohibir los sistemas de puntuación social como el utilizado por China, que es ampliamente considerado como una violación de los derechos humanos básicos. De lo contrario, todo lo que pueda dañar a los ciudadanos europeos mediante la manipulación de sus opiniones o decisiones, así como la inteligencia artificial que pueda utilizarse para la vigilancia masiva, se clasificará como “contraria a los valores de la Unión” y se prohibirá. Sin embargo, existen algunas excepciones que permitirían a las autoridades combatir el crimen y el terrorismo utilizando sistemas de reconocimiento facial.

Los deepfakes también están en la mira de la Comisión, pero no en la misma medida que otros usos de la IA. La tecnología puede realizar cambios muy convincentes en las imágenes y los videos, pero las herramientas de detección existentes no son lo suficientemente sofisticadas para capturar dicho contenido y etiquetarlo o eliminarlo adecuadamente antes de que se vuelva viral.

Empresas privadas como Facebook y Microsoft se han asociado con universidades para ayudar a mejorar estas herramientas, pero la Comisión Europea no quiere prohibir las deepfakes por completo. En cambio, los permitirá siempre que estén marcados como “creados o manipulados artificialmente”. Sin embargo, esta obligación “no se aplica cuando sea necesario con el fin de salvaguardar la seguridad pública [and other prevailing public interests] o para el ejercicio de un derecho o libertad legítimos de una persona y sujeto a las garantías adecuadas de los derechos y libertades de terceros. “

Del borrador filtrado, parece que la UE no cree que este problema merezca más que una serie de pequeños textos que acompañan a casi todos los deepfakes. Algunos pueden argumentar que hay muchos usos legítimos para la tecnología detrás de los deepfakes, como el entretenimiento, la recuperación de personalidades desaparecidas o la protección de su privacidad en línea. Sin embargo, la vaguedad de la propuesta plantea algunas preguntas sobre qué se hará para prevenir el abuso y el abuso por parte de las agencias gubernamentales.

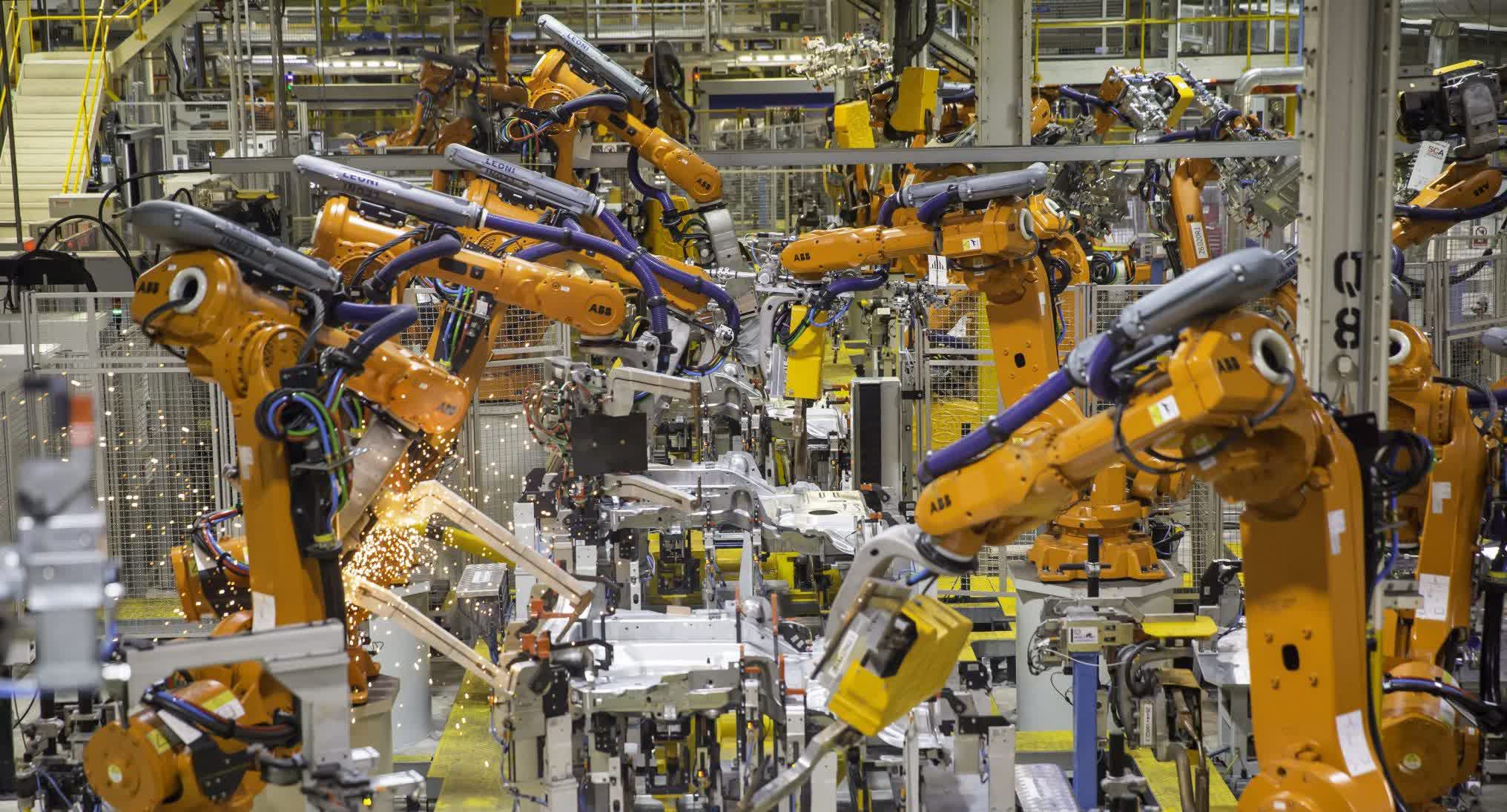

Por otro lado, Europa pretende acoger el desarrollo de sistemas de inteligencia artificial que ayuden en la producción, haciendo más eficiente la red energética, coches autónomos, cirugía remota, modelización del cambio climático o drogas. Además, el borrador propone la creación de una junta europea de IA como un mecanismo de monitoreo específico para las nuevas reglas.

No todo el mundo cree que la UE podrá hacer cumplir la regulación de la IA de forma tan estricta. En una entrevista, el ex director ejecutivo de Google, Eric Schmidt, que ahora es presidente de la Comisión de Seguridad Nacional de Inteligencia Artificial de EE. UU. (NSCAI), dijo que la estrategia de gobernanza de la IA de Europa no tendrá éxito porque “simplemente no es lo suficientemente grande del lado la plataforma para competir solo con China “.

El Centro Europeo para el Derecho sin Fines de Lucro, que es uno de los contribuyentes al Libro Blanco de la Comisión Europea sobre Inteligencia Artificial, cree que “el enfoque de la UE de la definición binaria de riesgo alto versus bajo es descuidado en el mejor de los casos. Hipótesis y peligroso en el peor, como carece del contexto y los matices necesarios para el complejo ecosistema de IA que ya existe en la actualidad “.

Enlace permanente a la historia.